Автоматизация сбора и анализа вакансий с Indeed с применением AI и Bright Data

Узнайте, как автоматизировать сбор и анализ вакансий с Indeed с помощью Bright Data и LLM для поиска актуальных сигналов найма. Руководство описывает настройку NoCode-инструментов, которые позволяют кратно ускорить процессы рекрутинга и повысить эффективность B2B-продаж.

Ручной поиск вакансий сегодня — это прошлый век. Рынок труда меняется каждый божий день, новые требования валятся по всем полям как из рога изобилия, а успеть за всем этим вручную нереально. С конкретной задачей автосборки вакансий все легко. Ты просто собираешь по сайтам на подобие Indeed информацию по условиям труда автоматом. И вместо часов (а то и дней жизни своей) получаешь в разы больше информации за считанные минуты: названия, требования, зарплаты, места и времени выхода. И действительно Indeed — это мощный гигант среди job boards. Свыше 250 миллионов уникальных пользователей в месяц посещает его. Это источник, дающий понимание рынка труда в реальном времени. Каждый день там появляется около 10 миллионов новых вакансий. Понимаете какой поток? Реальная золотая жила workforce analytics и прогнозирования — можно строить стратегии по притяжению талантов на реальных фактах, а не на догадках.

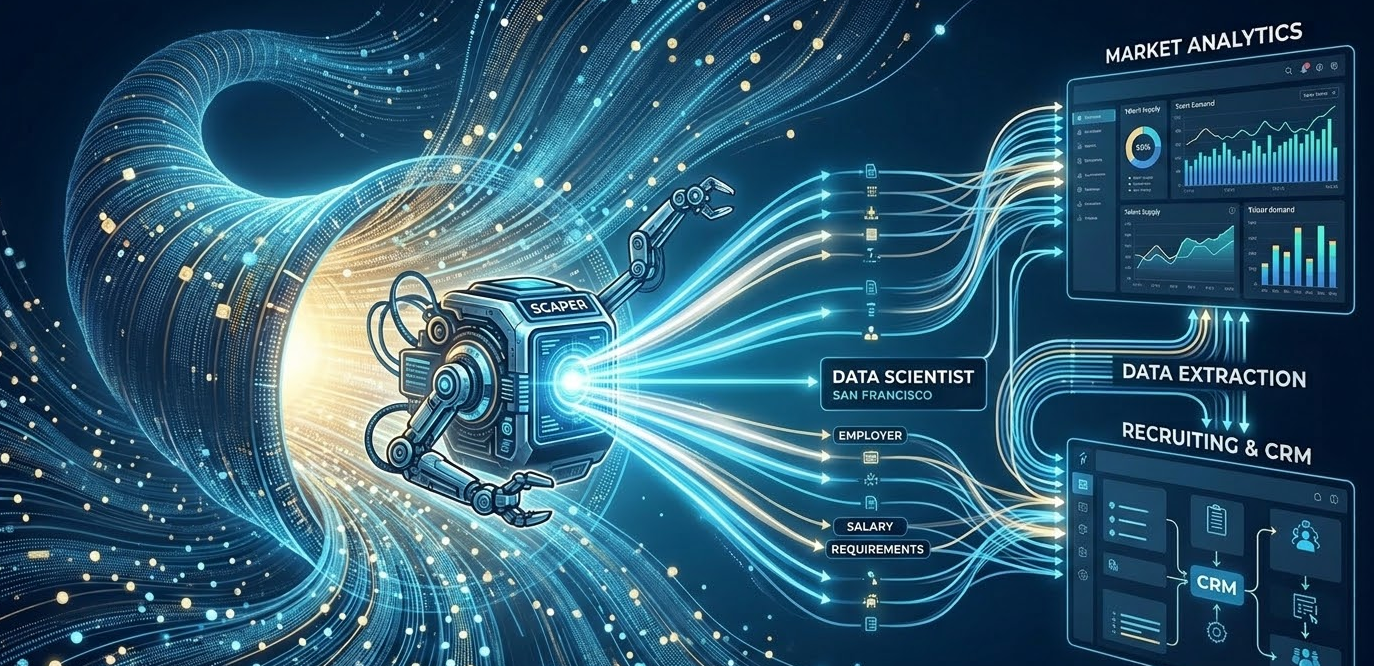

Технически все работает просто. Специальная программа, которую называют скрапером, по протоколу HTTP отправляет запросы к страницам самих Indeed, парсит HTML, извлекая нужные поля. Скажем, требуется вакансия Data Scientist в Сан-Франциско — значит скрипт прихватит всё по этому тэгу: кто работодатель, какие там зарплаты, требования, в общем — всё что угодно. В конечном итоге, полученную информацию можно использовать для анализа рынка, либо загрузить в CRM, что поможет в процессах рекрутинга и продаж. Удобно же.

Обзор существующих инструментов для Indeed job scraper

Доступный выбор инструментов довольно широкий. Условно их можно поделить на три больших группы.

- Платформы облачного типа с функционалом API: Bright Data, ScraperAPI, Apify. Взять к примеру Bright Data — вот это — да, серьезный игрок, свыше 72 миллионов резидентных IP, да и обход защит (CAPTCHA) — мощные фичи. Обойдется это удовольствие, начиная с пятисот долларов в месяц при большом количестве запросов — сто тысяч, соизмеримо с его качеством. Хотя ScraperAPI обойдется дешевле — всего 49 долларов, но настраивать его придется больше. Apify — это маркетплейс скриптов с гибкой системой цен.

- Фреймворки и библиотеки программистов: BeautifulSoup хорош для простого парсинга HTML, но с динамическим контентом Indeed не справляется. Scrapy — уже серьёзный фреймворк, чуть сложнее в освоении. Puppeteer умеет симулировать браузер и JavaScript, но потребляет ресурсы прилично.

- Платформы no-code: ASCN.AI NoCode, Octoparse, ParseHub. Примечательной особенностью ASCN.AI является встроенный AI-анализ — он сокращает временные расходы на подготовку данных и обеспечивает быстрое создание безкодовых workflow.

Сводная таблица инструментов:

| Инструмент | Порог входа | Стоимость | Обход защиты | Интеграция LLM |

|---|---|---|---|---|

| Bright Data | Низкий | От $500/мес | Да | Через API |

| ScraperAPI | Средний | От $49/мес | Да | Нет |

| Scrapy (Python) | Высокий | Бесплатно | Требует настройки | Нет |

| ASCN.AI NoCode | Низкий | От $29/мес | Да (через Bright Data) | Встроено |

| Octoparse | Низкий | От $75/мес | Частично | Нет |

На данный момент большинство уже — около 68% — команд комбинируют облачные решения и кастомные скрипты для того, чтобы обойти любые возможные ограничения и автоматизировать обработку данных. Правда, Indeed меняет структуру страниц где-то раз в три месяца, а значит, написанные на их основе скрипты нужно также дорабатывать раз в три месяца.

Кстати, легальность скрапинга зависит от того, соблюдаются ли правила Indeed, а также от того, нет ли автоматического обхода защит без их разрешения. Об этом речь пойдет в разделе «Легальность и этика».

Что означают Hiring Signals?

Это сигналы, которые свидетельствуют о том, что данная компания активна на рынке труда. Скорее всего, она расширяется, запускает новые проекты или обращается для решения проблемы найма. Для бизнеса, особенно сегмента B2B, подобные сигналы, это как раз те самые окна возможностей. Они подсказывают, когда нужно "входить" с предложением, когда у клиента высокая hiring intent, т.е. его заинтересованность в найме наивысшая.

Признаки сигналов найма:

- Увеличение количества вакансий. Если в течение квартала количество вакансий увеличилось с 5 до 30, значит, фирма явно находится на пути к расширению своего бизнеса.

- Открытие важных позиций VP, Head или C-level — свидетельствует о переменах в ориентации компании.

- Регионы, откуда идет новый поток вакансий — вновь открываются новые страны или города.

- Запрос на специалистов по конкретным технологиям — массовый поиск специалистов например по Kubernetes, Terraform, Rust.

- Срочность найма — "Urgent hire" или многократное дублирование вакансий.

Использование hiring signals увеличивает конверсию холодных контактов примерно на 23%. Это серьезная цифра. Из жизни ASCN.AI — в одном из проектов по мониторингу DeFi-компаний заметили: стартап за неделю открыл 8 позиций Backend Engineer-а с опытом Rust и Solana. И теперь в нужный момент смогли предложить инфраструктуру для блокчейн-данных и закрыли сделку за 10 дней. Реально работает.

Подходы нахождения сигналов с помощью LLM

Раньше анализ вакансий сводился к ключевым словам и регэкспам — но много чего важного пропускается. Сейчас современные LLM модели вроде GPT-4 или Claude понимают, что хотели сказать, ловят скрытые сигналы и даже читают интонацию объявления. Модели позволяют оценить не только уровень позиции, упоминаемые технологии, настроение текста, но и скрытые признаки, такие как недостаток упоминания роста команды или стратегических перемен. Возвращают структурированные данные в формате JSON — с указанием компании, позиции, технологий, срочности и других параметров.

{

"company": "название компании",

"position": "позиция",

"level": "junior|middle|senior|lead|executive",

"technologies": ["технология1", "технология2"],

"remote": "да|нет|гибрид",

"hiring_urgency": "низкая|средняя|высокая",

"growth_signals": ["масштабирование", "новый продукт"],

"competitor_mentions": ["продукт/компания"],

"team_size_hint": "численность или примерный размер",

"notes": "дополнительная информация"

}

Внутренние испытания ASCN.AI продемонстрировали результаты анализа с точностью 87–91%. Но надо помнить — LLM не панацея, надо вручную проверять и корректировать выводы.

Технологии и инструменты для автоматизации

Bright Data — известная платформа для масштабного, легального и стабильного скрапа. Сеть из 72 миллионов резидентных IP адресов, охватывающая 195 стран, позволяет гибко обойти возможные блокировки и CAPTCHA.

Что предлагают:

- Готовые шаблоны (Data Collector) для Indeed c умной пагинацией и выбором полей.

- Ротация IP-адресов осуществляется каждые 5-10 запросов, встроенный CAPTCHA Solver достигает точности 98%.

- Есть возможность получать данные через webhook в режиме реального времени через JSON.

Поэтому с точки зрения ценообразования выбран подход pay-as-you-go — около 0.001 за страницу или подписка от 500/месяц. Наиболее крупные компании получают enterprise-решения, имеющие SLA и кастомные условия.

Привожу пример запроса к API:

import requests

url = "https://api.brightdata.com/datasets/v2/trigger"

headers = {"Authorization": "Bearer YOUR_API_TOKEN"}

payload = {

"dataset_id": "gd_lvhjg9kii9p9sdflo",

"endpoint": "discover_new",

"filters": {

"keyword": "AI Engineer",

"location": "San Francisco",

"date_posted": "last_7_days"

},

"format": "json",

"webhook_url": "https://yourapp.com/api/new-jobs"

}

response = requests.post(url, headers=headers, json=payload)

print(response.json())

Интеграция LLM для анализа данных о вакансиях

Для полной автоматизации всего процесса ASCN.AI предлагает воспользоваться NoCode конструктором — быстро сконструировать свой pipeline:

- Webhook-триггер от Bright Data — новая вакансия попадет в систему.

- HTTP Request — получим текст объявления.

- AI Agent — отправим вакансию в GPT-4 Turbo или Claude с нужным промптом для разбора.

Важнейшая логика — это сортировка вакансий по критерию важности. К примеру "Горячая вакансия" для крайне актуальных, с требуемыми технологиями. Результаты записываем в Google Sheets, Airtable или CRM.

Промпт для LLM примерно такой:

Ты аналитик рынка труда. Извлеки из вакансии в JSON:

{

"company": "...",

"position": "...",

"level": "...",

"tech_stack": [...],

"hiring_urgency": "...",

"growth_signals": [...],

"competitor_mentions": [...],

"key_responsibilities": [...],

"team_size_hint": "..."

}

Для снижения затрат рекомендуется делать batch-запросы по 100 вакансий, кэшировать данные и постоянно оптимизировать модель.

Практическое руководство: как собрать данные и найти hiring signals.

- Регистрируемся в Bright Data, выбираем тариф или начинаем с trial.

- В разделе Data Collector создадим новый сбор — выберем Job Boards, а затем Indeed.

- Настройте фильтрационные параметры. "AI Engineer" — это ключевое слово, "San Francisco, CA" — это место расположения, "last_7_days" — это дата опубликования, "Full-time" — тип работы, а "от 120000 до 250000" — диапазон заработной платы (по необходимости).

- Поля отобрать для извлечения: job_id, title, company_name, location, description, salary_min/max, apply_url.

- Настройте доставку данных — Delivery → Webhook, указав URL сервера. Затем запустите сбор.

Обработка и анализ вакансий с помощью LLM

Для анализа вы можете использовать ASCN.AI NoCode — и разве не обычный пользователь сделает это за 15 минут? Пример кода для вызова OpenAI API:

import openai

import json

openai.api_key = "YOUR_API_KEY"

def analyze_job(description):

prompt = f"""

Проанализируй вакансию и извлеки: компания, позиция, уровень, технологии, срочность, сигналы роста.

Вставь текст вакансии:

{description}

"""

response = openai.ChatCompletion.create(

model="gpt-4-turbo",

messages=[{"role":"user", "content":prompt}],

temperature=0.3

)

return json.loads(response.choices[0].message.content)

result = analyze_job("Текст вакансии здесь")

print(result)

Практические советы

- Ограничивайте скорость ваших запросов.

- Кэшируйте уже обработанные вакансии — это экономит время и деньги.

- Работайте с ошибками через retry и экспоненциальный бэкофф.

- Регулярно следите за изменениями в структуре сайта Indeed и обновляйте сценарии для скрапинга.

- Все дело в соблюдении GDPR — не собирайте персональные данные.

Примеры применения и кейсы

История из жизни — благодаря ASCN.AI криптобиржа с поддержкой искусственного интеллекта в значительной степени смогла снизить время на подбор Backend Engineer с профилем по Rust и Solana. С полугода до двух месяцев. За это время закрыли 12 из 15 вакансий. Экономия HR-отдела, с учетом сокращения количества резюме, составила более 200 часов. Это действительно ощутимая поддержка.

С помощью возможностей LLM можно анализировать не только текущие вакансии в своей компании, но вакансии конкурентов и на основании полученных данных выявлять конверсионные навыки и требования, после чего оптимизировать свое описание вакансий — как один из способов увеличения конверсии откликов. Примером такого оптимизационного действия является оптимизация условий труда — добавление формата remote/hybrid. В результате рост заявок составил пятьдесят процентов, а сложнейшую позицию Senior Frontend Developer закрыл всего за две недели.

Вопрос-ответ (FAQ)

- Сколько вакансий можно собрать? До 100 000 в день при соответствующем тарифе Bright Data.

- Можно ли скрапить вакансии из других стран? Да, коллекторы дают возможность указать любой другой регион.

- А как часто следует обновлять данные? При продаже B2B — раз в неделю, при рекрутменте — каждый день.

- А что делать с блокировками? Рекомендуется использовать прокси с ротацией, Solver для решения CAPTCHA, снижать скорость запросов.

- Значит, можно скрапить контактные данные? Нет, это было бы нарушением GDPR и нарушением правил Indeed.

- Скрапинг законен? Да, если соблюдены условия использования и при условии, что не осуществляется сбор персональных данных.

Проблемы легальности и этичности скрапинга

Скрапить можно лишь в том случае, если это не нарушает Terms of Service платформы и законы, включая GDPR. Важно не собирать персональные данные без согласия и не пытаться обойти защиту автоматически, также без разрешения.

Как можно обойти блокировки и ограничения сайта

Как обойти блокировки сайта и ограничения его работы? Использовать динамическую ротацию IP, использовать инструменты автоматического решения CAPTCHA, существенно снижать скорость запросов, комбинировать облачные сервисы с локальными скриптами.

Заключение и советы

Автоматизация сбора анкет и анализа вакансий с Indeed с использованием Bright Data и LLM — это метод, который значительно ускоряет сбор и обработку, выявление hiring signals и, полагаясь на факты, а не на домыслы, принятие решения.

Рекомендации по наращиванию и расширению процессов:

- Приступите с тестового сбора на 500-1000 вакантных местах и проверьте качество данных и анализ.

- Настройте полную автоматизацию через ASCN.AI NoCode для обработки и анализа.

- Интегрируйте полученные лиды в CRM и настраивайте оповещения для отделов продаж.

- Систематически анализируйте эффективность и не забывайте обновлять скрипты.

- Расширяйте источники — вводите LinkedIn, Glassdoor и прочие платформы.

Как AI-агенты и NoCode-системы ASCN.AI помогают зарабатывать на автоматизации скрапинга

Раньше, чтобы заняться скрапингом, нужно было собрать команду разработчиков и настроить инфраструктуру. Каждое обновление Indeed ломало парсеры. ASCN.AI NoCode решает задачу за 15 минут, без одной строки кода — соберите пайплайн из триггеров, HTTP-запросов и AI агентов.

Примеры монетизации:

- Hiring Intelligence как сервис: генерация отчетов с анализом вакансий и рекомендациями. Отчет генерируется за 2 минуты и стоит от $50 до $200. Тогда, когда мы говорим о 10 заказах в день — получается до $2000 в сутки при минимально возможных расходах на API.

- Автоматизация рекрутмента: интеграция c LinkedIn и GitHub для поиска кандидатов, AI пишет персонализированные сообщения. Время, затрачиваемое на найм, сокращается с 6 до 1-2 месяцев, что означает увеличение выручки на $100K–150K в год.

- Высочайшая результативность B2B-продаж, осуществляемых на основе hiring signals: автоматические оповещения и письма менеджерам по продажам позволяют повысить коэффициент конверсии с 2-3% до 8-12%. Причем один новый клиент дает до $600K дополнительного дохода в год.

Запуск такого механизма обойдется примерно в $149/месяц:

- ASCN.AI NoCode — 29 $/мес

- Bright Data API (10K вакансий) — 50 $/мес

- OpenAI GPT-4 (анализ 10K вакансий) — 70 $/мес

Предполагаемая прибыль — 500 $ - 5000 $ и более в месяц. Все проверено сотнями клиентов ASCN.AI.